물어봐

BETA

인공지능이 위험한 이유를 구체적으로 알려줘

IT 지식이 풍부한 고양이 ‘요고’가 답변해 드려요.

인공지능이 위험한 이유는 다양한 측면에서 나타납니다. 첫째로, 정보 양극화가 심화되는 문제입니다. 인공지능은 학습을 통해 지식을 얻는데, 이 과정에서 주어진 데이터에 기반한 패턴을 도출합니다. 그런데 데이터에는 이미 정보 양극화가 반영될 수 있기 때문에, 인공지능의 결정이 편향될 수 있습니다. 이로 인해 다양한 시각이 반영되지 못하고, 특정 그룹이나 이해관계자의 이익이 우선시되는 결과를 초래할 수 있습니다.

둘째로, 개인정보 및 사생활 침해가 위험이 될 수 있습니다. 인공지능은 대규모의 데이터를 분석하고 처리하는 능력을 가지고 있습니다. 이는 개인정보를 포함한 민감한 정보들까지 파악하는데 사용될 수 있습니다. 이는 개인의 권리를 침해하고 신상정보 유출 등의 문제를 야기할 수 있습니다. 또한, 인공지능 챗봇 서비스와 같이 인간의 대화를 모방하는 기술은 불완전성을 가지고 있습니다. 따라서 인공지능은 부작용이나 역기능을 일으킬 수 있습니다.

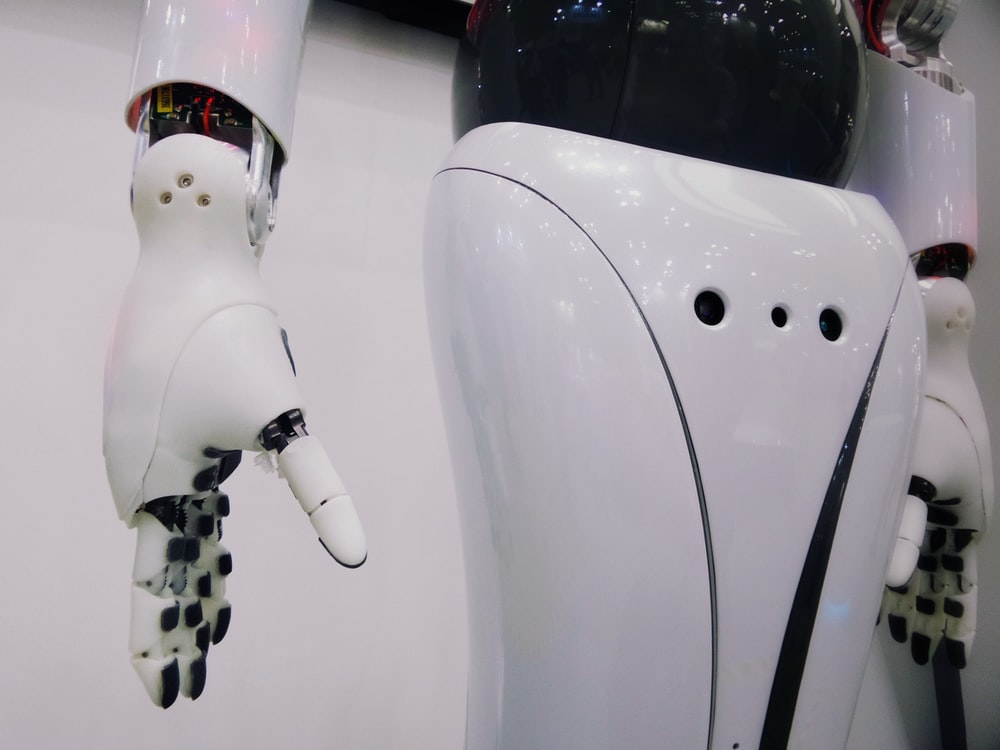

셋째로, 인공지능이 인간의 지능을 본뜬 형태라고 해서 불쾌감을 줄 수 있습니다. 인간은 자신을 능가할 수 있는 힘이나 지능을 가진 존재에 대해 불안과 불쾌함을 느낄 수 있습니다. 특히, 인간과의 정서적인 교류가 되지 않는다면 더욱 불쾌감이 커질 것으로 예상됩니다. 게다가, 인공지능이 인간과 닮아서 피아식별이 어렵다면 공포감은 더 커질 수 있습니다. 이는 생존 본능이 가져다주는 자연스러운 반응이라고 볼 수 있습니다.

이러한 이유들로 인해 인공지능은 위험과 부작용을 야기할 수 있습니다. 따라서 인간은 인공지능의 개발과 활용에 대해 신중한 접근이 필요하며, 적절한 규제와 윤리적인 고려가 반드시 이루어져야 합니다.

열심히 읽고 답변했어요!