물어봐

BETA

AutoRAG와 ollama를 사용해서 로컬 LLM 챗봇을 만들고 싶은데 어떻게 만들어야 해?

IT 지식이 풍부한 고양이 ‘요고’가 답변해 드려요.

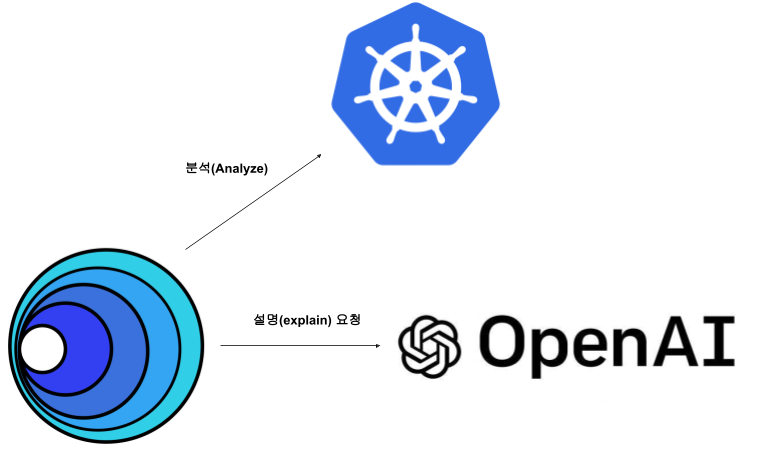

AutoRAG와 ollama를 사용해서 로컬 LLM 챗봇을 만들고 싶다면, 먼저 해당 솔루션들을 설치하고 설정해야 해요. ollama를 통해 언어 모델을 구현할 수 있도록 도와주는데, 이를 활용하여 LLM 챗봇을 만들 수 있어요. AutoRAG를 활용하면 ollama를 통해 만든 모델을 불러와 챗봇으로 활용할 수 있어요. 따라서 설치 및 설정 과정을 완료한 후에는 AutoRAG와 ollama를 연동하여 로컬 LLM 챗봇을 만들 수 있을 거예요. 어렵게 생각하지 말고 차근차근 진행해보세요!

열심히 읽고 답변했어요!