8월 초, 애플은 아동들을 보호하기 위한 새로운 시스템을 몇 가지 발표했다. 이 시스템들은 연말에 이루어지는 업데이트(iOS 15, iPadOS 15, watchOS 8, macOS Monterey)에 포함될 예정이다. 새로 소개된 내용 중 '사용자들 사진을 스캔하여 아동 성착취물의 확산'을 막는 시스템이 있었다. 이 부분이 큰 오해를 샀다. 마치 애플이 소설 1984의 빅브라더처럼 아이폰 사용자들의 사생활을 멋대로 들여다본다는 식으로 이야기가 확산됐기 때문이다.

사용자 사진은 어떤 방식으로 스캔되는지, 정확히 어떤 부분에서 오해가 발생했는지, 그래서 결국 결론이 뭔지 함께 알아보자.

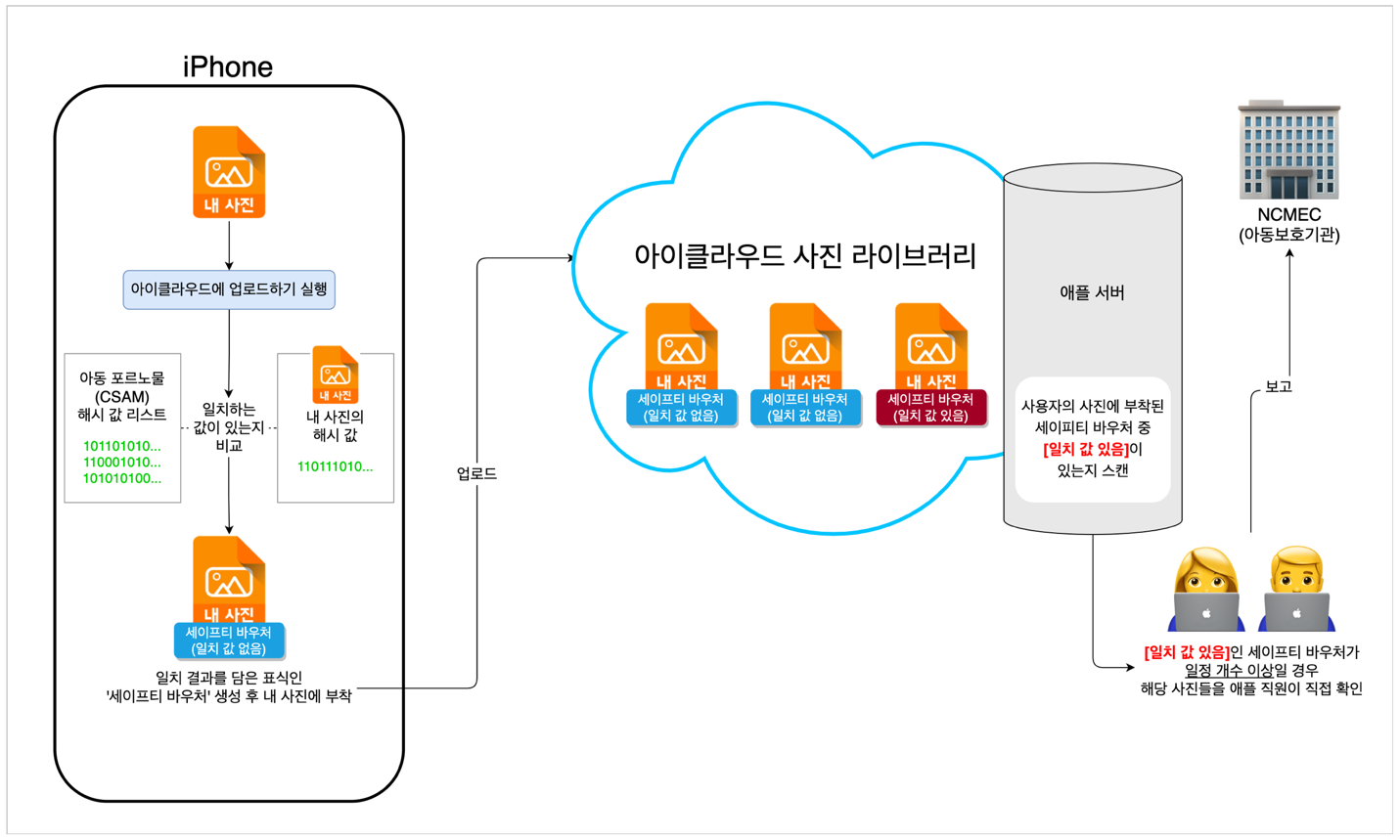

일단 사진의 스캔은 아이클라우드에 백업할 경우에만 이루어진다. 아이클라우드에 업로드하지 않으면 스캔은 이루어지지 않는다. 사진을 아이클라우드에 업로드하면 업로드를 위한 준비 작업이 시작된다. 일단 내가 올리는 사진의 해시 값(암호화 값)이 아동 성착취물의 해시 값 리스트와 비교하는 작업이 이루어진다. '사용자의 사진에 아동 성착취물의 특징이 담겨있는가?'를 체크하는 것이다. 체크가 끝나면 체크 결과가 담긴 '세이프티 바우처'라는 딱지가 사진에 붙여진 후 아이클라우드에 업로드된다.

사진 업로드가 끝나면 애플 서버는 업로드된 사진의 딱지를 확인한다. 딱지에는 사진이 아동 성착취물인지 아닌지에 대한 체크 결과를 담고 있으므로, 애플 서버는 (굳이) 사진을 스캔하지 않고 딱지에 쓰인 결과만 확인한다. 만약 '아동 성착취물 맞음'이라고 쓰인 딱지가 일정 개수 이상 발견되면(발표된 내용을 보면 30개일 것으로 예상) 애플 직원에게 '이 사용자는 아동 성착취물 소유자인 듯?'이라며 알림이 발송된다. 애플 직원은 '아동 성착취물 맞음' 딱지가 붙은 사진을 직접 눈으로 확인한 후, 필요시 아동 보호기관인 NCMEC(National Center for Missing & Exploited Children)에게 보고하는 것으로 프로세스가 완료된다.

참고로 초반 업로드 과정에서 활용되는 '아동 성착취물의 해시 값 리스트'는 NCMEC이 애플에게 제공하는 식으로 업데이트된다. 그리고 일반 포르노물은 괜찮다. 적용되는 프로세스는 아동 성착취물에 초점을 맞추고 있다.

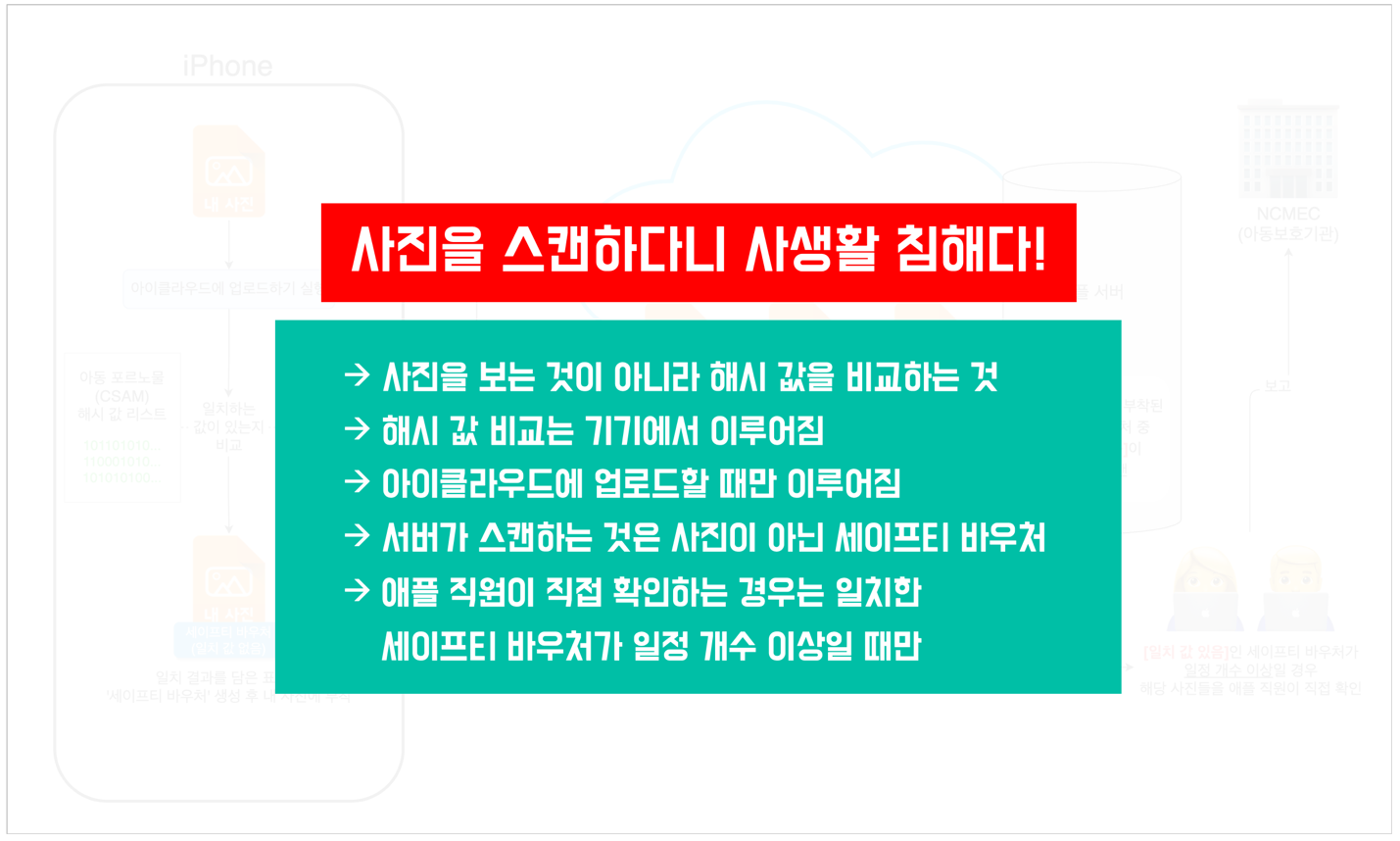

애플의 발표 내용을 주의 깊게 살펴보지 않으면 '애플이 내 사진을 엿본다'라고 결론짓기 쉽다. 그리고 실제로 그런 오해가 널리 퍼졌다. 아이폰 마케팅에서 '개인 정보 보호'를 끊임없이 강조해온 애플이 변했다며 화난 사람들이 많았다. 1984년에 맥킨토시를 발매하면서 빅브라더를 타도하겠다던 애플이었는데 이제는 그들 자신이 빅브라더가 되었다며 손가락질을 받았다.

오해하는 사람도 많고 자극적인 헤드라인의 기사가 퍼지다 보니 애플의 수석 부사장인 크레이그 페더리기(애플 이벤트에서 iOS 내용을 발표할 때 자주 보이는 사람)가 직접 나섰다. 그는 월스트리트 저널과의 인터뷰를 통해 아동 성착취물 체크 시스템이 작동하는 방식을 설명하고 오해받는 부분을 해명했다.

인터뷰의 주요 내용을 정리해보면 다음과 같다.

한 줄로 요약하자면, 사용자의 사진 라이브러리를 (아동 성착취물을 여러 개 백업한 것이 아닌 이상) 있는 그대로 들여다볼 일 없으니 안심하라는 내용이었다.

해시 값을 대조하는 것이니 문제없다며 넘어가는 사람들 중에서도, 대조하는 해시 값 자체에 의문을 품는 이들이 있다. 해시 값 대조 과정에서 활용되는 아동 성착취물 해시 값 리스트는 애플이 직접 만든 리스트가 아니다. 위에서 언급한 아동 보호기관 NCMEC이 구축한 시 값 데이터베이스에서 가져온 것이다. 즉, 해시 값을 대조하는 시스템은 애플이 만들었지만, 사용자의 사진이 아동 성착취물인지 아닌지는 NCMEC가 제공한 데이터에 의존하고 있는 것이다(아마 OS 버전 업데이트와 함께 해시 값 리스트도 계속 업데이트될 것이다).

애플과 협력하는 기관이니 믿을만하겠거니 할 수도 있지만, 'NCMEC의 해시 값 믿을만한 거야?' '혹시라도 해시 값이 잘못 대조돼서 내가 아동 성범죄자로 오해받으면 어떡해?'라며 우려하는 사람들의 입장도 이해가 간다. 또, 만약 애플이 아동 성착취물 말고 다른 것도 체크하기 시작한다면? 정치적 목적의 해시 값 리스트를 만들어 체크한다면? 대부분의 사람들은 그럴 일은 없을 거라고 이야기하지만(나도 그렇게 생각한다) 그렇게 될 가능성이 생겼다는 것 자체가 불편함을 주고 있는 듯하다.

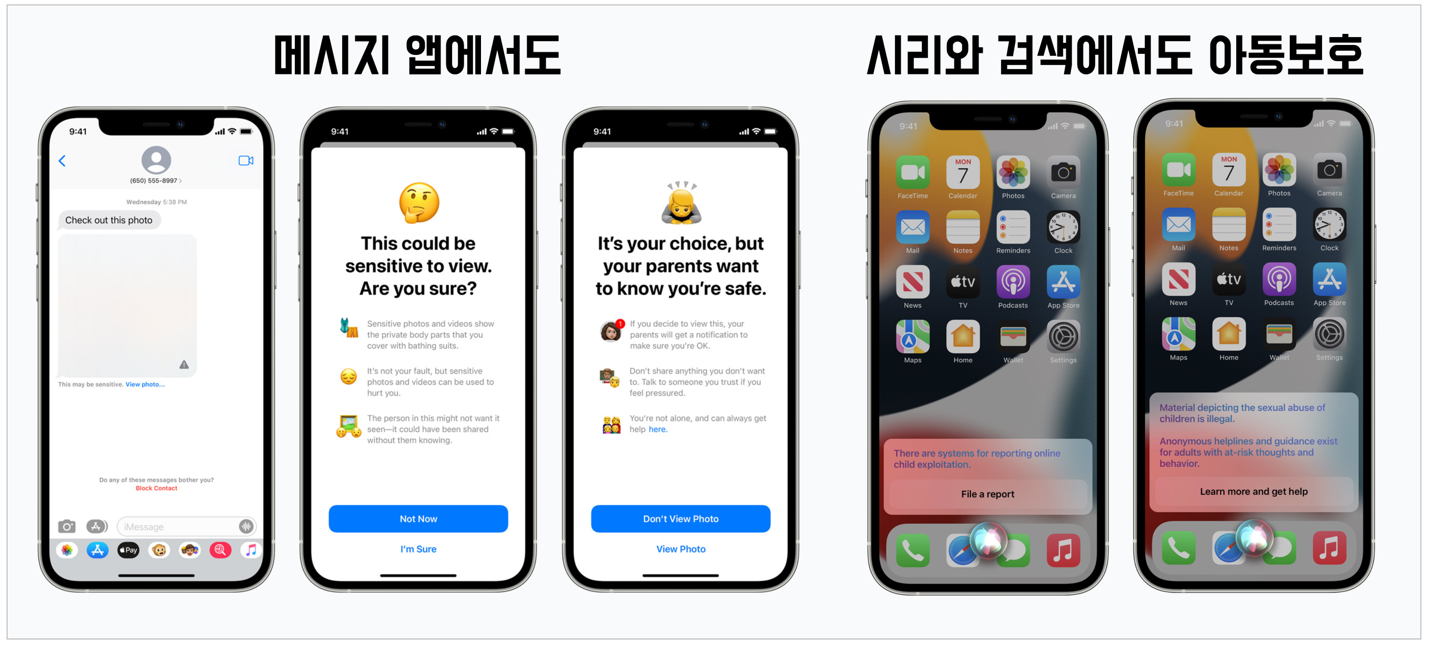

메시지 앱에도 보호 기능이 추가된다. 만약 사용자가 아동이고, 그 아동이 메시지 앱에서 주고받는 사진이 성(性)적인 내용이라면 일단 그 사진의 미리보기가 가려진다(즉, 누군가 성적인 사진을 아동에게 보냈다면 아동이 그 사진을 보지 못하게 가리는 것). 성적인 사진인지 아닌지는 온전히 아이폰 내에서 기계 학습을 통해 이루어진다.

아동이 가려진 사진을 누르면 경고 문구가 나온다('보기 불편한 사진일 수 있어요' '수영복으로 가리는 부위가 노출되는 사진일 수 있어요' 등). 대부분의 아동은 호기심을 이기지 못하고 '보기' 버튼을 누를 텐데, 그런 경우를 위해 '보는 건 너의 선택이지만 부모님에게 알림이 갈 것이다'라는 2차 경고가 표시된다. 참고로 아동이 성적인 사진을 보낼 때에도 똑같이 경고가 이루어지며 이 기능을 사용하려면 아동과 부모의 애플 계정이 아이클라우드 가족 계정으로 묶여있어야 한다.

시리와 검색에도 아동보호 기능이 추가되는데, 구체적으로는 두 가지다. 하나는 아동 성착취물이나 학대 관련해 신고하고 싶다고 시리에게 말하면 어떻게 신고할 수 있는지 구체적으로 안내해준다. 다른 하나는 아동 성착취물을 검색하는 경우인데, 검색을 하면 '유해한 주제입니다'라며 검색 결과를 제한한다.

이번에 발표된 업데이트는 모두 아동보호에 초점이 맞춰져 있다. 훌륭한 취지의 업데이트이지만, 사진 스캔 부분에서 '사생활 침해다!'라며 욕을 먹었다. 아이폰을 안전한 운영체제로 만드는 것은 애플의 비전이다. 그러니 아무리 문제 제기가 있다한들, 애플이 아동 성착취물과 유해 매체를 스마트하게 필터링할 수 있는 시스템을 철회할 가능성은 거의 없을 것이다. 그보다는 사용자들의 오해를 잠재우기 위한 홍보와 필터링 오류를 최소화하기 위한 작업을 계속해나갈 것이다.

개인적으로 애플이 도입하는 시스템은 합리적이라고 생각한다. 정부 기관이 지시한 것도 아닌데 먼저 나서는 것도 좋고, 오차범위를 고려해 '일정 개수 이상'이라는 조건을 설정한 것도 마음에 든다. 아동 성착취물을 클라우드에 백업하는 범죄자가 아닌 다음에야 실사용에는 아무 영향 없을 것이다.

사용자 입장에서 이 시스템이 정 찝찝하다면 아이클라우드 백업을 하지 않는 선택지도 있다. 다른 클라우드나 직접 구축한 개인 서버에 백업하는 것도 방법이다. 자신이 쓰는 서비스가 어떤 보안 시스템을 가지고 있는지 잘 알아보고 사용하면 된다. 클라우드 자체가 찝찝하면 외장하드를 쓰면 된다.

글을 쓰다 보니 애플의 시스템을 변호하는 느낌이 되어버렸는데, 나는 안드로이드 폰 사용자라 이번 애플의 업데이트는 나와 크게 상관없다.

<참고 자료>

©️요즘IT의 모든 콘텐츠는 저작권법의 보호를 받는 바, 무단 전재와 복사, 배포 등을 금합니다.